Agentes de IA em produção: o que líderes devem exigir agora

Por que ler isto agora

Nos últimos dias a conferência GTC 2026 e uma rodada de atualizações de segurança mostraram duas coisas claras: agentes de IA estão prontos para entrar em processos críticos — e a superfície de risco associada também aumentou. Para quem lidera empresas, não é mais suficiente avaliar modelos apenas por precisão; é preciso exigir observabilidade, controles de segurança e contratos que preservem dados e responsabilidade.

O que mudou no mundo real

NVIDIA e outros players anunciaram avanços em infraestruturas e frameworks para sistemas agentic, abrindo caminho para agentes que coordenam tarefas, executam ações e interagem com sistemas empresariais. Ao mesmo tempo, patches recentes (Patch Tuesday de março de 2026) corrigiram vulnerabilidades que demonstraram como integrações de assistentes em produtividade podem ser vetores de exfiltração de dados quando não há controles adequados.

Por que isso importa para o negócio

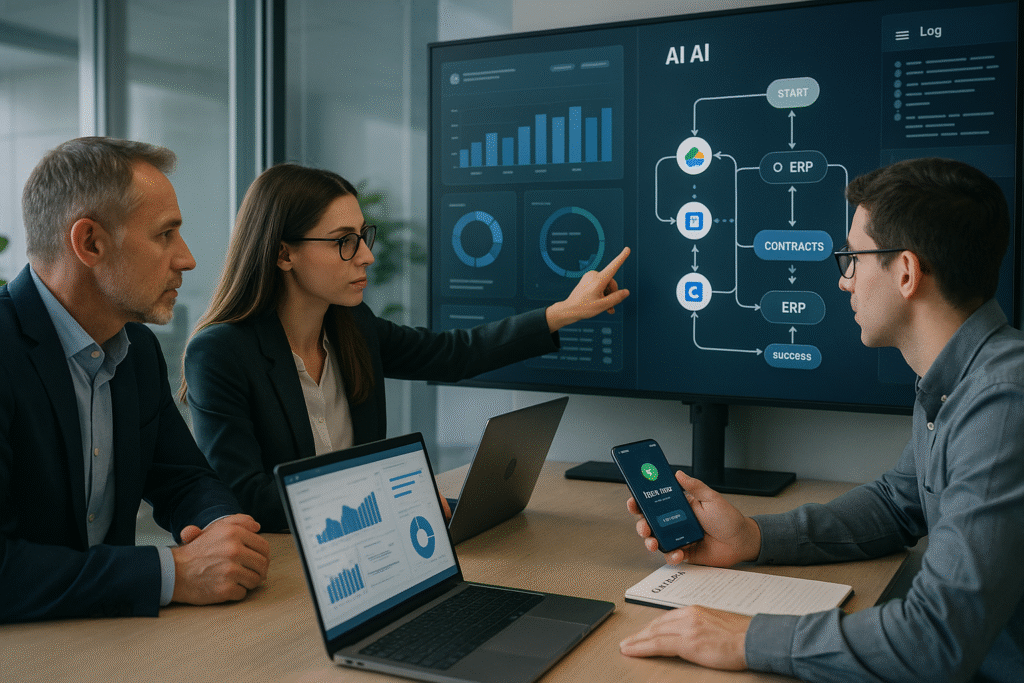

Quando um agente altera um contrato, autoriza uma cobrança ou atualiza o ERP, o impacto é financeiro e jurídico. Sem trilhas de evidência e telemetria, você não conseguirá explicar uma decisão, responder a auditoria nem gerenciar riscos. Isso transforma observability e segurança em requisitos de compras, não em extras de engenharia.

O que os líderes precisam exigir — checklist prático

- Logs append-only exportáveis: cada execução deve gerar pacote com input hash, output hash, versão do agente e identificador do usuário.

- Métricas operacionais: latência, taxa de erro, drift do modelo e contagem de reversões (quando uma ação automática foi corrigida por humano).

- Regra de exceção humana: qualquer ação que impacte tributos, caixa ou contratos exige aprovação explícita.

- Isolamento de dados e não‑treino: contratos com fornecedores devem proibir reuso dos dados do cliente para treinar modelos sem consentimento explícito.

- Controle de egress e telemetria de rede: bloqueie destinos de saída não autorizados e monitore picos de egress relacionados a agentes.

Como isso se relaciona com tecnologia e segurança

Anúncios de infraestruturas especializadas para agentic AI mostram que a indústria está resolvendo gargalos de performance e armazenamento — mas também criando novos pontos de controle que precisam ser geridos. Vulnerabilidades em integrações de assistentes de produtividade lembram que tanto a arquitetura quanto a configuração operam como primeira linha de defesa.

Como implantar um piloto seguro (0–45 dias)

0–7 dias — mapeamento: identifique workflows candidatos (contratos padrão, conciliação, atendimento automatizado) e avalie impacto financeiro e regulatório.

7–21 dias — requisitos e seleção: peça aos fornecedores evidências de observability (logs, métricas, hooks de exportação) e um plano de segurança (patch cadence, gestão de segredos, políticas de egress).

21–45 dias — piloto governado: rode um piloto limitado com regras de exceção, coleta completa de telemetria e métricas de qualidade. Meça tempo salvo, taxa de reversão e tempo para gerar pacote de auditoria.

O lado humano da transformação

Automação desloca julgamento, não o elimina. Profissionais devem ser treinados para interpretar logs, identificar falso‑positivos e assumir responsabilidade por decisões sensíveis. Transparência com o cliente e documentação clara se tornam ativos de confiança.

Riscos que não podem ser ignorados

- Silos de memória entre agentes: memórias fragmentadas levam a decisões incoerentes.

- Observability insuficiente: degradação silenciosa que só é detectada tarde demais.

- Exposição de dados por integrações mal configuradas: agentes com acesso amplo a repositórios criam vetores de exfiltração.

- Dependência de fornecedor sem cláusulas de evidência: dificulta auditoria e migração.

O que isso revela sobre o futuro

Empresas que transformarem governança em diferencial ganharão velocidade com segurança. Em poucos meses, observability e requisitos contratuais passarão a ser filtros básicos em processos de procurement de IA.

Quer transformar esse requisito em vantagem competitiva? Converse com a Morph. Ajudamos líderes a desenhar perímetros, implantar observability e criar playbooks de governança que tornam agentes confiáveis em produção.

Fontes

- NVIDIA Newsroom — NVIDIA CEO Jensen Huang and Global Technology Leaders to Showcase Age of AI at GTC 2026.

- ITPro — Nvidia targets open source interoperability with new model coalitions, agentic frameworks.

- PCWorld — Microsoft’s March 2026 update fixes 80+ security vulnerabilities.

- ArXiv — AgentTrace: A Structured Logging Framework for Agent System Observability (Feb 2026).

- Tom’s Hardware — Nvidia launches BlueField-4 STX storage architecture for agentic AI (GTC 2026).