Quando o assistente vaza: o caso Copilot e o que líderes empresariais devem fazer hoje

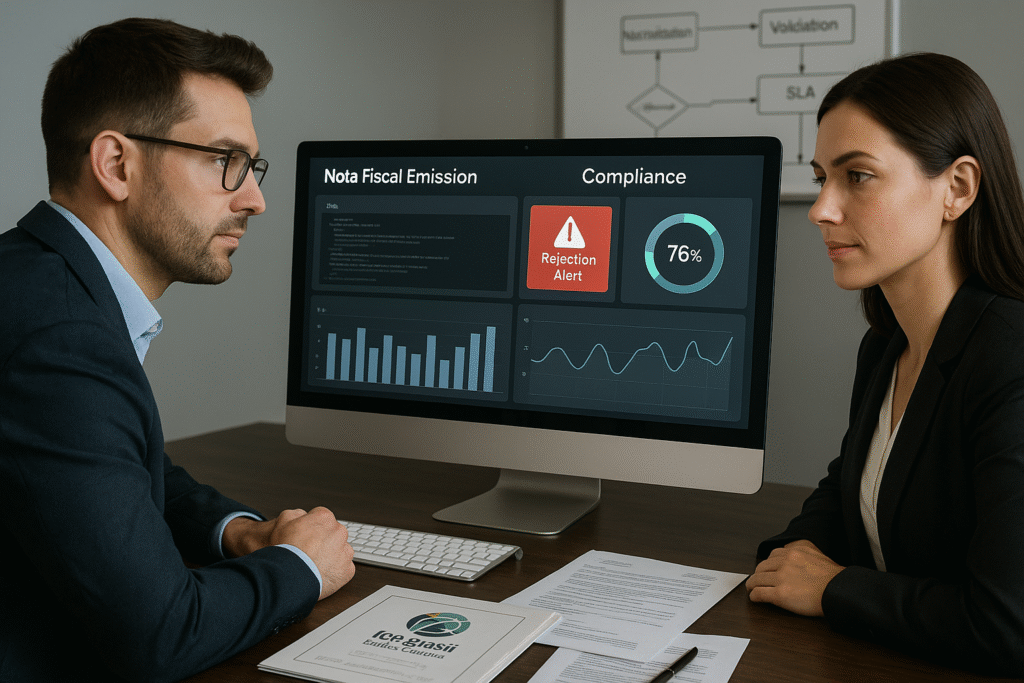

Um bug em uma ferramenta corporativa expõe um risco que muitas empresas subestimam: a inteligência artificial pode quebrar as regras que você acreditava terem sido impostas. No caso recente do Microsoft 365 Copilot, um erro de código (rastreado como CW1226324) permitiu que o assistente resumisse e processasse e‑mails marcados como confidenciais entre late January e fevereiro de 2026 — justamente quando muitas organizações já estavam integrando o Copilot aos fluxos operacionais.

Por que isso importa agora

Empresas adotam IA para acelerar decisões, automatizar relatórios e ajudar times a encontrar informação. Mas quando as proteções falham, o impacto não é só técnico: vira risco legal, regulatório e reputacional. Setores regulados — saúde, financeiro, jurídico — podem perder controle sobre dados sensíveis mesmo quando políticas internas parecem válidas.

O que aconteceu (em poucas linhas)

Relatos públicos e alertas de serviço apontam que, desde 21 de janeiro de 2026, o Copilot Chat processou itens nas pastas Sent Items e Drafts que continham rótulos de sensibilidade. A falha não permitiu acesso por usuários não autorizados, segundo a Microsoft, mas fez com que conteúdos marcados como “Confidential” fossem ingeridos e resumidos pelo modelo. A empresa começou a distribuir correções no início de fevereiro, e o incidente ficou registrado como CW1226324.

O que isso muda no mundo real

Do ponto de vista prático, três efeitos são imediatos:

- Reforço da auditoria de terceiros: confiar cegamente em proteções de fornecedores não é mais aceitável. É preciso testar cenários reais de utilização e verificar logs.

- Revisão de classificação de dados: muitos rótulos de sensibilidade são mal aplicados na prática. Se só 3–5% dos documentos têm rótulo ativo (um problema comum), a lacuna operacional vira risco técnico quando IA entra na equação.

- Pressão regulatória e contrapartes: clientes e reguladores vão exigir provas da segurança de fluxos que utilizam assistentes — especialmente após casos reportados em serviços públicos como o NHS.

Como líderes podem reagir — roteiro prático em 5 passos

Este é um plano direto, desenhado para ser acionável em semanas, não meses.

- Verifique seu inventário de IA e pontos de integração. Liste onde Copilot (ou ferramentas equivalentes) tem acesso a e‑mail, drives, SharePoint, ERPs e CRMs. Identifique quais pastas e fluxos têm informação confidencial.

- Audite políticas e cobertura de DLP. Simule casos reais: rascunhos, envios automatizados e forwardings. Confirme se rótulos e políticas de DLP realmente bloqueiam a ingestão para a camada de IA — não apenas o acesso humano.

- Exija logs e evidência imutável. Toda chamada ao assistente que toque dados sensíveis deve gerar um registro com timestamp, ID do recurso, rótulo de sensibilidade aplicado e versão do serviço ou patch aplicado. Esse artefato é essencial em casos de revisão ou auditoria.

- Implemente perímetros de confiança mínimos. Onde possível, bloqueie o processamento de itens em pastas que tendem a conter rascunhos (Drafts, Sent) ou dados regulados. Prefira que o modelo consulte apenas extratos ou metadados e peça confirmação humana antes de processar conteúdos inteiros.

- Comunicação com fornecedores e plano de contingência. Exija SLAs de segurança, comunicação proativa de incidentes e playbooks para rollback. Se o seu fornecedor demora a entregar correções, tenha rotas alternativas (desligar integração, modo offboarding seguro, usar instância isolada on‑prem).

O lado humano

Não é só tecnologia: equipes precisam entender limites e responsabilidades. Treine times de compliance, TI e líderes de produto para interpretar alertas de DLP, validar correções e tomar decisões de exposição. Crie papéis claros: owner de política de dados, responsável por integração de IA e comitê de risco com rotinas semanais de revisão.

Governança como vantagem competitiva

Empresas que formalizarem controles ganham confiança do cliente. Em contratos B2B, seja claro sobre onde a IA é usada, quais garantias existem e o que será documentado. Oferecer relatórios de governança e evidência técnica vira diferencial comercial — e reduz exposição em fiscalizações e litígios.

O que isso revela sobre o curto prazo

Incidentes como o do Copilot aceleram duas tendências: (1) maior exigência de provas técnicas por parte de clientes e reguladores; (2) maturidade em arquitetura que separa dados sensíveis das camadas generativas por design. Em outras palavras, a capacidade de orquestrar confiança será tão estratégica quanto a capacidade de implantar modelos.

Checklist rápido para as próximas 2 semanas

- Rodar simulação de DLP contra integrações do Copilot (ou equivalente).

- Capturar logs de todas as interações com assistentes corporativos na última janela de 60 dias.

- Atualizar playbooks de resposta a incidentes com passos específicos para falhas de ingestão de dados por IA.

- Comunicar clientes-chave e partes interessadas sobre a revisão de controles (transparência pró‑ativa reduz risco reputacional).

Quer ajuda para transformar preocupação em ação prática? Converse com a Morph. Ajudamos a auditar integrações de IA, testar políticas de DLP em cenários reais e criar controles que tornam a automação segura, comprovável e escalável.

Fontes

- BleepingComputer — Microsoft says bug causes Copilot to summarize confidential emails (18 Feb 2026)

- TechCrunch — Microsoft says Office bug exposed customers’ confidential emails to Copilot AI (18 Feb 2026)

- VentureBeat — Microsoft Copilot ignored sensitivity labels twice in eight months (20 Feb 2026)

- Office365ITPros — DLP Policy for Copilot Bug Exposes Confidential Email (13 Feb 2026)

- TechRadar — Microsoft admits an Office bug exposed confidential user emails to Copilot (19 Feb 2026)