PL 6707/25 e a responsabilidade por IA: o que escritórios contábeis precisam fazer agora

Por que esse assunto é relevante agora

Em março de 2026 a Câmara dos Deputados discutiu o Projeto de Lei 6707/25, que amplia a responsabilidade civil por danos causados por sistemas de inteligência artificial. Para escritórios contábeis, que cada vez mais incorporam ferramentas de IA em rotinas fiscais, de folha e de auditoria, essa proposta muda a equação de risco: o uso de IA passa a ser também uma questão contratual, de seguro e de controles operacionais.

O que está mudando no mundo real

O PL propõe alterar o Código de Defesa do Consumidor para responsabilizar fornecedores e desenvolvedores quando um sistema de IA causar prejuízo ao consumidor — inclusive nos casos em que o nexo causal é difícil de provar devido à “opacidade algorítmica”.

Na prática, isso significa três consequências imediatas para escritórios e prestadores de serviços contábeis:

- Risco contracional ampliado: cláusulas de responsabilidade com fornecedores de SaaS e modelos poderão ser objeto de litígio.

- Necessidade de evidência técnica: será preciso demonstrar logs, versões de modelo e decisões humanas para rebater alegações de dano.

- Pressão por due diligence: clientes e auditores vão exigir comprovação de governança sobre os sistemas que suportam lançamentos e cálculos fiscais.

Como escritórios podem reagir — roteiro prático

A seguir, um plano de ação pragmático e priorizado para as próximas 6 semanas, que reduz exposição e transforma conformidade em diferencial comercial.

- Inventário imediato (1 semana): catalogue todas as ferramentas de IA usadas internamente e pelos clientes — classificadores, geração de texto (memórias fiscais, relatórios), bots de conciliação e ferramentas de automação. Registre finalidade, dados de entrada e responsável técnico.

- Revisão contratual (2 semanas): exija cláusulas mínimas nos contratos com fornecedores: obrigação de fornecer logs sob solicitação, compromisso de não-treinar modelos com dados sensíveis do cliente, SLA de segurança e cláusula de indenização limitada – ou, quando possível, seguro de responsabilidade tecnológico.

- Logs e trilha de prova (2–3 semanas): implemente logs append-only que gravem inputs, versão do modelo, prompt/parametrização e resultado. Para processos fiscais e lançamentos contábeis, padronize o anexo desses metadados como evidência do trabalho realizado.

- Checkpoints humanos em decisões de impacto: toda saída que altere lançamentos fiscais, tributos ou aprovações contratuais deve ter um aprovador humano identificado. Defina gatilhos (limiares) que disparem revisão manual.

- Seguro e provisão de contingência: avalie apólices de responsabilidade tecnológica e, se preciso, crie provisões para contingências relacionadas a decisões automatizadas.

- Treinamento e playbooks (contínuo): monte playbooks para investigação de incidentes (como reproduzir o caso, coletar logs e comunicar clientes) e treine equipes em análise de outputs, prompts e em documentar justificativas.

O lado humano da transformação

Governança não é só técnica — é comportamento. Contadores deixam de ser apenas verificadores de números e passam a ser curadores de evidência. Isso exige duas frentes: capacitação prática (como reproduzir uma decisão da IA, interpretar scores de confiança e identificar vieses) e comunicação clara com clientes sobre limites da automação.

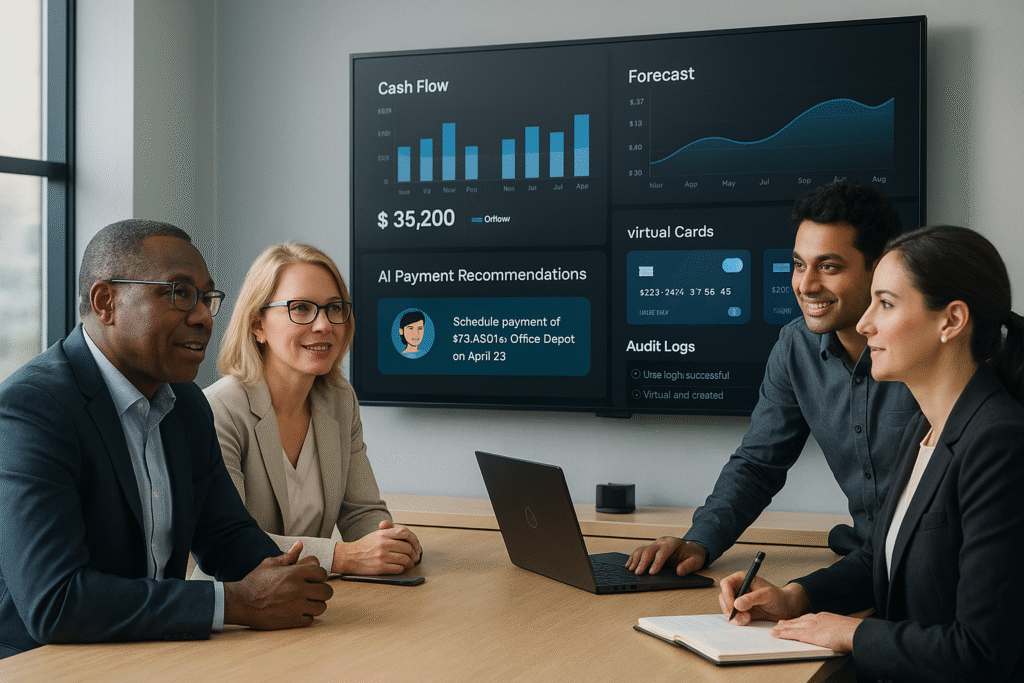

Como transformar conformidade em vantagem competitiva

Escritórios que anteciparem essas medidas podem vender isso como serviço: pacotes de Governança de IA para Contabilidade que combinem inventário, revisão contratual, implementação de logs e apólices de seguro. Esses pacotes reduzem risco do cliente em fiscalizações e auditorias — e criam fonte de receita recorrente para o escritório.

Riscos que não podem ser ignorados

- Opacidade algorítmica: sem trilha de prova, provar boa-fé ou ausência de erro será custoso.

- Responsabilidade solidária: contratos frágeis podem deixar o escritório desprotegido em litígios.

- Falhas em massa: automações que replicam erro em milhares de documentos aumentam a exposição financeira e reputacional.

O que isso revela sobre o que vem a seguir

A agenda legislativa torna óbvio um movimento global: quem usa IA em processos críticos será chamado a demonstrar controle, explicabilidade e mitigação de risco. Nos próximos 12 meses veremos maior demanda por evidência técnica, cláusulas contratuais robustas e produtos de seguro para cobrir riscos específicos de IA.

Checklist rápido (30 dias)

- Completar inventário de IA para seus 20 maiores clientes.

- Adicionar cláusulas padrão de logs e não‑treino em 100% dos novos contratos.

- Implementar logs estruturados para 1 processo crítico (ex.: cálculo de impostos).

- Treinar 1 squad em playbook de investigação de incidentes.

Quer ajuda para colocar isso em prática? Converse com a Morph. Ajudamos escritórios a mapear riscos, negociar contratos com fornecedores, implementar trilhas de prova e transformar governança em um novo serviço comercial.

Fontes

- Portal Contábeis — PL propõe responsabilização por danos causados por IA (04/03/2026).

- Agência Câmara dos Deputados — Projeto responsabiliza empresas por danos de inteligência artificial (03/03/2026).

- Telesíntese — Câmara analisa PL que responsabiliza fornecedores por danos causados por IA (Mar 2026).

- European Parliament / contexto internacional — discussão regulatória sobre IA (Mar 2026).